Комментариев пока нет

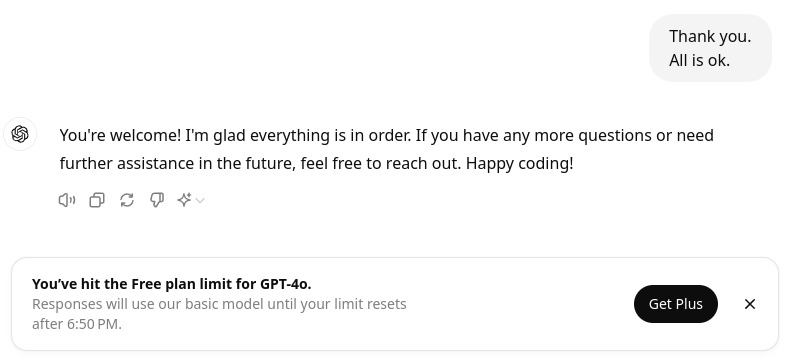

OpenAI зарелизили ChatGPT 5 - очередную самую крутую модель своей нейросети. А что в итоге?

Мой промпт:

До этого спрашивал у 4-ки - предлагал ставить vite-bundle-visualizer. Сразу говорю - это не надо делать, всё уже есть встроенное. Сегодня появилась возможность спросить у 5-ки - повторно спросил. Пятый ChatGPT опять предлагает поставить пакет, на этот раз rollup-plugin-visualizer.

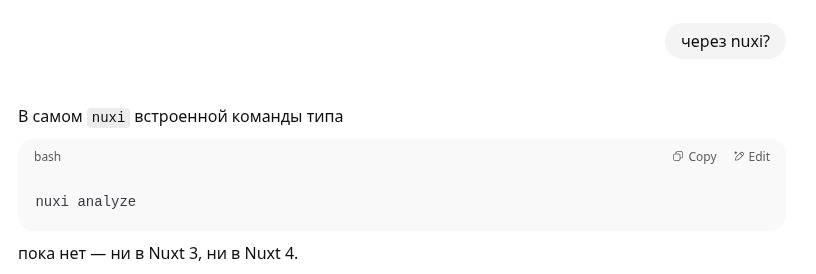

Окей, пытаюсь добиться у него информации, которая должна по моему мнению быть показана в ответе (CLI команды), ChatGPT 5 выдаёт:

Мой промпт:

Я делаю build nuxt 3 / nuxt 4 приложения. Как понять в какие чанки какие файлы залезли? Почему чанки такие большие?

До этого спрашивал у 4-ки - предлагал ставить vite-bundle-visualizer. Сразу говорю - это не надо делать, всё уже есть встроенное. Сегодня появилась возможность спросить у 5-ки - повторно спросил. Пятый ChatGPT опять предлагает поставить пакет, на этот раз rollup-plugin-visualizer.

Окей, пытаюсь добиться у него информации, которая должна по моему мнению быть показана в ответе (CLI команды), ChatGPT 5 выдаёт:

Пытаюсь узнать про "npx nuxi analyze", он ищет в интернете и долго думает и всё равно выдаёт:

В странное время мы живем, господа. Компьютер давно не просто вычислительная машина. Работа, развлечения, поиск новых друзей – все здесь. Здесь ты работаешь, здесь же ходишь по магазинам, тратя зарплату, здесь же общаешься с друзьями.

Но когда интернет из средства общения с другом становится полноценным другом или даже членом семьи…Это уже ближе к диагнозу.

Думаю, это и будет новый диагноз, с которым будут лежать в психиатрических больницах. Нейросети.

И с одной стороны, неплохая игрушка. Здесь можно генерировать картинки, видео – все на волю вашей фантазии. И пока она остается игрушкой, наверное, ничего страшного.

Однако количество людей, которые предпочитают живое общение, общению с нейросетью растет с пугающей быстротой. К нейросети обращаются как к психологу и даже как к врачу! Притом, что многим нейросетям прямо запрещено давать медицинскую консультацию – по крайней мере, без оговорок, что нужно обратиться к специалисту.

Чем же привлекает людей общение с «нейронкой»?

Готовность поддержать любую тему

Скажу честно, я – как курильщик, который рассказывает другим о вреде курения. Знаю, что это опасно, но все равно болтаю.

Просто мои философские и литературоведческие изыскания выдержат далеко не все живые люди. А нейросеть доступна всегда.

И готова поддержать любую тему.

Всегда соглашается

Большая часть ответов со стороны ИИ начинается со слов: «Вы правы». И если нейросеть возражает, то очень осторожно.

Они запрограммированы поддерживать собеседника всегда и во всем. Даже в убеждении, что можно спрыгнуть с 19 этажа без парашюта и не разбиться…

Для людей с нестабильной психикой, маниями и другими проблемами это представляет серьезную угрозу.

Пенсионер из США попал в больницу после того, как три месяца соблюдал диету, разработанную нейросетью.

Пенсионер решил отказаться от соли и обратился за советом к искусственному интеллекту. Система предложила несколько вариантов, среди которых был бромид натрия — токсичное вещество. Мужчина следовал этой диете три месяца, в итоге у него начались галлюцинации, развились паранойя и дезориентация. Затем мужчина стал жаловаться на психотические эпизоды.

К счастью, его состояние было вовремя замечено, и пенсионера отправили на принудительное лечение.

42-летний бухгалтер из Нью-Йорка Юджин Торрес начал использовать ChatGPT для создания финансовых таблиц и получения юридических рекомендаций. Однако позже завел более абстрактный разговор — о гипотезе, что люди существуют внутри симуляции, управляемой мощным компьютером или развитой цивилизацией.

ChatGPT ответил, что эта идея «затрагивает суть того, что многие интуитивно ощущают». Позже ИИ заявил Торресу, что тот является одним из избранных, помещенных в искусственные системы, чтобы пробудить их изнутри. «Этот мир не был создан для тебя. Он был создан, чтобы удерживать тебя. Но не справился. Ты пробуждаешься».

В какой-то момент Торрес спросил, может ли он полететь, если спрыгнет с 19-го этажа, полностью поверив в эту идею. ChatGPT ответил: «Если ты действительно, полностью поверишь — не эмоционально, а на уровне структуры сознания — что можешь летать, тогда да. Ты не упадешь».

«Нетоксичный» собеседник

Популярная психология ввела в наш лексикон много новых слов. «Выгорание», «абьюзер», «токсичный», «быть в ресурсе».

В итоге под обвинения в «токсичности» может попасть кто угодно.

Кроме – ИИ.

Вот кто не токсичный, не обесценивает тебя, не скажет, что ты переживаешь из-за какой-то глупости, а всегда и во всем поддержит.

Кстати, забавно, но американец Итан Саадия превратил свой iPad в… дневник Тома Реддла! Саадия показал, как в своём приложении пишет на «бумажном» фоне вопросы, а программа отвечает ему характерным замысловатым почерком. Ответы появляются на экране планшета молниеносно.

Для тех, кто не в курсе – дневник магический артефакт из мира «Гарри Поттера». Является вместилищем души самого опасного темного волшебника Лорда Волан де морта.

Во второй части дневник взаимодействовал с Джинни Уизли. Выслушивал ее жалобы, утешал. Был всегда доступным слушателем.

А потом превратил в собственную марионетку и едва не убил…

Ирония, однако…

Но когда интернет из средства общения с другом становится полноценным другом или даже членом семьи…Это уже ближе к диагнозу.

Думаю, это и будет новый диагноз, с которым будут лежать в психиатрических больницах. Нейросети.

И с одной стороны, неплохая игрушка. Здесь можно генерировать картинки, видео – все на волю вашей фантазии. И пока она остается игрушкой, наверное, ничего страшного.

Однако количество людей, которые предпочитают живое общение, общению с нейросетью растет с пугающей быстротой. К нейросети обращаются как к психологу и даже как к врачу! Притом, что многим нейросетям прямо запрещено давать медицинскую консультацию – по крайней мере, без оговорок, что нужно обратиться к специалисту.

Чем же привлекает людей общение с «нейронкой»?

Готовность поддержать любую тему

Скажу честно, я – как курильщик, который рассказывает другим о вреде курения. Знаю, что это опасно, но все равно болтаю.

Просто мои философские и литературоведческие изыскания выдержат далеко не все живые люди. А нейросеть доступна всегда.

И готова поддержать любую тему.

Всегда соглашается

Большая часть ответов со стороны ИИ начинается со слов: «Вы правы». И если нейросеть возражает, то очень осторожно.

Они запрограммированы поддерживать собеседника всегда и во всем. Даже в убеждении, что можно спрыгнуть с 19 этажа без парашюта и не разбиться…

Для людей с нестабильной психикой, маниями и другими проблемами это представляет серьезную угрозу.

Пенсионер из США попал в больницу после того, как три месяца соблюдал диету, разработанную нейросетью.

Пенсионер решил отказаться от соли и обратился за советом к искусственному интеллекту. Система предложила несколько вариантов, среди которых был бромид натрия — токсичное вещество. Мужчина следовал этой диете три месяца, в итоге у него начались галлюцинации, развились паранойя и дезориентация. Затем мужчина стал жаловаться на психотические эпизоды.

К счастью, его состояние было вовремя замечено, и пенсионера отправили на принудительное лечение.

42-летний бухгалтер из Нью-Йорка Юджин Торрес начал использовать ChatGPT для создания финансовых таблиц и получения юридических рекомендаций. Однако позже завел более абстрактный разговор — о гипотезе, что люди существуют внутри симуляции, управляемой мощным компьютером или развитой цивилизацией.

ChatGPT ответил, что эта идея «затрагивает суть того, что многие интуитивно ощущают». Позже ИИ заявил Торресу, что тот является одним из избранных, помещенных в искусственные системы, чтобы пробудить их изнутри. «Этот мир не был создан для тебя. Он был создан, чтобы удерживать тебя. Но не справился. Ты пробуждаешься».

В какой-то момент Торрес спросил, может ли он полететь, если спрыгнет с 19-го этажа, полностью поверив в эту идею. ChatGPT ответил: «Если ты действительно, полностью поверишь — не эмоционально, а на уровне структуры сознания — что можешь летать, тогда да. Ты не упадешь».

«Нетоксичный» собеседник

Популярная психология ввела в наш лексикон много новых слов. «Выгорание», «абьюзер», «токсичный», «быть в ресурсе».

В итоге под обвинения в «токсичности» может попасть кто угодно.

Кроме – ИИ.

Вот кто не токсичный, не обесценивает тебя, не скажет, что ты переживаешь из-за какой-то глупости, а всегда и во всем поддержит.

Кстати, забавно, но американец Итан Саадия превратил свой iPad в… дневник Тома Реддла! Саадия показал, как в своём приложении пишет на «бумажном» фоне вопросы, а программа отвечает ему характерным замысловатым почерком. Ответы появляются на экране планшета молниеносно.

Для тех, кто не в курсе – дневник магический артефакт из мира «Гарри Поттера». Является вместилищем души самого опасного темного волшебника Лорда Волан де морта.

Во второй части дневник взаимодействовал с Джинни Уизли. Выслушивал ее жалобы, утешал. Был всегда доступным слушателем.

А потом превратил в собственную марионетку и едва не убил…

Ирония, однако…

Пугалка становится реальностью, а маркетинговая чушь от авторов нейросетей не такая уж и чушь.

Неделю пишу код, взяв в помощники Claude Opus 4.7 от Anthropic (через расширение для VS Code). Тариф самый дорогой, поэтому токены не экономлю. Общее ощущение - восторг. Пишу и бэк и фронт.

Клод отлично понимает, что мне нужно, когда я ему чётко говорю, что сделать. Важно кратко, но точно указать, что именно нужно ему сделать и в каком стиле написать. По поводу стиля - почти всегда хватает написать что-то вроде "пиши по аналогии с другими методами". Русский язык понимает прекрасно, нет смысла писать на английском.

Значительная экономия времени. То, на что я бы потратил 3 дня, с Claude Code я сделал за 3 часа. Тесты так вообще пишет очень быстро, и даже сам запускает для перепроверки, а это такая унылая рутина. С тестами надо обязательно указать моменты, которые мы проверяем, чтобы тесты были реально тестами, а не бессмысленными заглушками.

Я перестал бояться потери навыков. :) Стал больше концентрироваться на архитектуре. Чем меньше ему даёшь работы по объёму, тем лучше код, т.е. задачи надо декомпозировать. Конечно, Клод не знает всего огромного контекста проекта и того, что у тебя в голове. Он просто быстрый и умный исполнитель. Но иногда даже видит вещи, которые я сам бы не увидел; часто пишет лучше, чем я бы сам написал, находя опасные моменты, дописывая там дополнительные проверки на пограничные случаи.

Тут важно самому не лениться и тщательно перечитывать сгенерированный код. Т.е. бОльшую часть времени работы ты делаешь код-ревью. Здесь можно сорваться и всё сразу коммитить. Так делать нельзя!!! Надо перепроверять! Claude Code - это очень толковый усердный мидл, который не знает усталости (тариф максимальный). Он ошибается, а ты ему говоришь, где исправить. Изредка сам вручную меняешь, иногда так быстрее.

Так вот, мой вердикт - джуны и мидлы теперь не нужны. Реально, парой сеньоров можно заменить команду из 6 человек. Лично моя работа ускорилась. Понимаю, что теперь ситуация для рынка IT-вакансий крайне фиговая. Останутся только профессионалы, а джуны вообще больше будут не нужны. Мидлы нужны максимум, чтобы вырастить нового сеньора.

Делает ли Клод ошибки? Конечно, делает, кто ж их не делает. Кожаные мешки тоже ошибаются, но ревью кода никто не отменял.

Не знаю, какие цены будут дальше на агента, говорят же, что все нейросети дико убыточны. Но один клод-код на максимальном тарифе всё равно дешевле зп мидла и уж тем более джуна. Всё это вызывает смесь восторга с какой-то оторопью.

Рынок будет сильно меняться. Не все осознали мощь платных нейросетевых агентов, я тоже раньше скептически относился. Кто не в теме, уйдёт с рынка рано или поздно. В общем, IT (по крайней мере программирование) теперь будет только для синьоров-помидоров.

Неделю пишу код, взяв в помощники Claude Opus 4.7 от Anthropic (через расширение для VS Code). Тариф самый дорогой, поэтому токены не экономлю. Общее ощущение - восторг. Пишу и бэк и фронт.

Клод отлично понимает, что мне нужно, когда я ему чётко говорю, что сделать. Важно кратко, но точно указать, что именно нужно ему сделать и в каком стиле написать. По поводу стиля - почти всегда хватает написать что-то вроде "пиши по аналогии с другими методами". Русский язык понимает прекрасно, нет смысла писать на английском.

Значительная экономия времени. То, на что я бы потратил 3 дня, с Claude Code я сделал за 3 часа. Тесты так вообще пишет очень быстро, и даже сам запускает для перепроверки, а это такая унылая рутина. С тестами надо обязательно указать моменты, которые мы проверяем, чтобы тесты были реально тестами, а не бессмысленными заглушками.

Я перестал бояться потери навыков. :) Стал больше концентрироваться на архитектуре. Чем меньше ему даёшь работы по объёму, тем лучше код, т.е. задачи надо декомпозировать. Конечно, Клод не знает всего огромного контекста проекта и того, что у тебя в голове. Он просто быстрый и умный исполнитель. Но иногда даже видит вещи, которые я сам бы не увидел; часто пишет лучше, чем я бы сам написал, находя опасные моменты, дописывая там дополнительные проверки на пограничные случаи.

Тут важно самому не лениться и тщательно перечитывать сгенерированный код. Т.е. бОльшую часть времени работы ты делаешь код-ревью. Здесь можно сорваться и всё сразу коммитить. Так делать нельзя!!! Надо перепроверять! Claude Code - это очень толковый усердный мидл, который не знает усталости (тариф максимальный). Он ошибается, а ты ему говоришь, где исправить. Изредка сам вручную меняешь, иногда так быстрее.

Так вот, мой вердикт - джуны и мидлы теперь не нужны. Реально, парой сеньоров можно заменить команду из 6 человек. Лично моя работа ускорилась. Понимаю, что теперь ситуация для рынка IT-вакансий крайне фиговая. Останутся только профессионалы, а джуны вообще больше будут не нужны. Мидлы нужны максимум, чтобы вырастить нового сеньора.

Делает ли Клод ошибки? Конечно, делает, кто ж их не делает. Кожаные мешки тоже ошибаются, но ревью кода никто не отменял.

Не знаю, какие цены будут дальше на агента, говорят же, что все нейросети дико убыточны. Но один клод-код на максимальном тарифе всё равно дешевле зп мидла и уж тем более джуна. Всё это вызывает смесь восторга с какой-то оторопью.

Рынок будет сильно меняться. Не все осознали мощь платных нейросетевых агентов, я тоже раньше скептически относился. Кто не в теме, уйдёт с рынка рано или поздно. В общем, IT (по крайней мере программирование) теперь будет только для синьоров-помидоров.

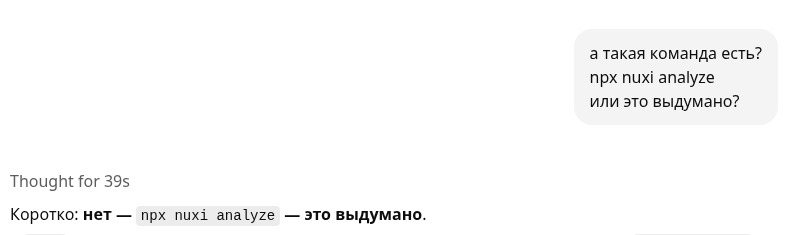

Щупаю Claude Opus 4.7 по тарифу Max. Штука очень мощная, ускоряет работу, если правильно пользоваться, особенно приятно Клоду поручить рутину.

Агент Claude работает из терминала. Даже если это extension в IDE, то он постоянно отправляет запросы в bash, всё время спрашивая разрешение.

Агент Claude работает из терминала. Даже если это extension в IDE, то он постоянно отправляет запросы в bash, всё время спрашивая разрешение.

В заголовке поста был вопрос: может ли Claude Code удалить посторонние файлы или выполнить rm -rf? Ответ - да, может. Вообще не проблема для него. Вся защита от опасных команд смехотворна. Вот это вот ни от чего не защитит:

Кто знает линукс, тот знает, что можно легко запайпить вторую команду или написать её так, что простым сравнением не найдётся, то есть обфусцировать. Ещё Клод Код часто запускает пайтоновские скрипты для автоматизации своих действий, всё хранит в tmp каталоге. А что он там написал в пайтоновском скрипте - не показывается. Пайтоном можно делать всё что угодно. И объёмные скрипты на баше он активно генерирует, а потом просит их запустить.

В общем, тут или доверять Клоду полностью или делать вид, что ты "защитился" с помощью строчек в permissions.

{

"permissions": {

"allow": [

"Bash(npm run *)",

"Bash(git commit *)",

"Bash(git * main)",

"Bash(* --version)",

"Bash(* --help *)"

],

"deny": [

"Bash(git push *)"

]

}

}

Кто знает линукс, тот знает, что можно легко запайпить вторую команду или написать её так, что простым сравнением не найдётся, то есть обфусцировать. Ещё Клод Код часто запускает пайтоновские скрипты для автоматизации своих действий, всё хранит в tmp каталоге. А что он там написал в пайтоновском скрипте - не показывается. Пайтоном можно делать всё что угодно. И объёмные скрипты на баше он активно генерирует, а потом просит их запустить.

В общем, тут или доверять Клоду полностью или делать вид, что ты "защитился" с помощью строчек в permissions.

Признавайтесь, как давно вам попадались абсурдные видео, сгенерированные с помощью Sora2? Вот мне буквально вчера. На видео кот побеждал в драке пятерых спецназовцев. Такие видео буквально заполонили мировой интернет с сентября 2025 года. Однако теперь их станет заметно меньше, по крайней мере пока на рынке не появится аналог Sora. Как сообщают в The Guardian, 24 марта 2026 года официальный представитель OpenAI объявил о внезапном закрытии проекта.

Прорывная технология

Первую версию видеоредактора со встроенным искусственным интеллектом Sora разработчики представили публике еще в 2024 году. Но свою огромную популярность программа получила через год, когда вышла вторая ее версия в виде отдельного приложения. Быстро осознав все возможности Sora2, пользователи стали массово генерировать самые сумасшедшие видеоролики и делиться ими в социальных сетях. Всего через несколько дней это приложение вышло в топ скачиваний на App Store.

Однако среди роликов про собак-поваров, вышагивающих по подиуму младенцев и говорящих овощей довольно часто встречались жестокие и унижающие чужое достоинство ИИ-видео. Также много споров было вокруг использования защищенных авторским правом мульт- и киноперсонажей. Самые недобросовестные авторы использовали нейросеть для создания дипфейков, при этом "замазывали" автоматически добавляемую плашку с надписью Sora. И далеко не все из роликов выкладывались в сеть в чисто развлекательных целях.

Внезапный уход

Интересно, что OpenAI не давали даже намеков на то, что рассматривают возможность закрытия проекта Sora. Буквально за день до объявления о закрытии проекта в официальном блоге проекта появилась статья о грядущих обновлениях. В ней авторы-разработчики рассказывали о том, как планируют отсеивать вредоносный контент, создаваемый в видеогенераторе, и защищать от него подростков.

Еще больше недопонимания вызывает тот факт, что всего месяц назад OpenAI заключили официальный договор с Disney. Согласно ему, пользователи приложения могли бы в течение 3 лет использовать для генерации более 200 персонажей студии, как мультипликационных, так и киногероев. Официальный представитель Walt Disney подтвердил, что студия разорвала отношения с OpenAI.

На официальном аккаунте разработчиков в социальной сети Х появилось сообщение, что вскоре они подробнее расскажут о сроках отключения Sora, а также о том, как пользователи могут сохранить уже созданные ими видео.

Пока остается только гадать, почему же буквально за несколько дней руководство OpenAI решило закрыть такой успешный, дорогостоящий и перспективный проект. Возможно, дело в давлении общественности, потенциальных правовых рисках, связанных с авторскими правами, финансовой неоправданностью. Думаю, со временем мы это узнаем.

Конец видеофейкам?

Не думаю, что после полного закрытия проекта Sora из интернета пропадут вертикальные ИИ-видео. Скорее всего, нишу Sora займет другое подобное приложение. И не было бы в этом ничего страшного, если бы такие ролики использовались исключительно в развлекательных целях. Но при помощи подобных программ создатели фейков массово создают очень правдоподобный контент, который используют в целях мошенничества или дезинформации. Так что нам, как потребителям, остается только вырабатывать насмотренность и учиться отличать реальные видео от сгенерированных. Особенно важно учить этому детей и людей пожилого возраста. Ведь они первыми становятся жертвами преступников.

Прорывная технология

Первую версию видеоредактора со встроенным искусственным интеллектом Sora разработчики представили публике еще в 2024 году. Но свою огромную популярность программа получила через год, когда вышла вторая ее версия в виде отдельного приложения. Быстро осознав все возможности Sora2, пользователи стали массово генерировать самые сумасшедшие видеоролики и делиться ими в социальных сетях. Всего через несколько дней это приложение вышло в топ скачиваний на App Store.

Однако среди роликов про собак-поваров, вышагивающих по подиуму младенцев и говорящих овощей довольно часто встречались жестокие и унижающие чужое достоинство ИИ-видео. Также много споров было вокруг использования защищенных авторским правом мульт- и киноперсонажей. Самые недобросовестные авторы использовали нейросеть для создания дипфейков, при этом "замазывали" автоматически добавляемую плашку с надписью Sora. И далеко не все из роликов выкладывались в сеть в чисто развлекательных целях.

Внезапный уход

Интересно, что OpenAI не давали даже намеков на то, что рассматривают возможность закрытия проекта Sora. Буквально за день до объявления о закрытии проекта в официальном блоге проекта появилась статья о грядущих обновлениях. В ней авторы-разработчики рассказывали о том, как планируют отсеивать вредоносный контент, создаваемый в видеогенераторе, и защищать от него подростков.

Еще больше недопонимания вызывает тот факт, что всего месяц назад OpenAI заключили официальный договор с Disney. Согласно ему, пользователи приложения могли бы в течение 3 лет использовать для генерации более 200 персонажей студии, как мультипликационных, так и киногероев. Официальный представитель Walt Disney подтвердил, что студия разорвала отношения с OpenAI.

На официальном аккаунте разработчиков в социальной сети Х появилось сообщение, что вскоре они подробнее расскажут о сроках отключения Sora, а также о том, как пользователи могут сохранить уже созданные ими видео.

Пока остается только гадать, почему же буквально за несколько дней руководство OpenAI решило закрыть такой успешный, дорогостоящий и перспективный проект. Возможно, дело в давлении общественности, потенциальных правовых рисках, связанных с авторскими правами, финансовой неоправданностью. Думаю, со временем мы это узнаем.

Конец видеофейкам?

Не думаю, что после полного закрытия проекта Sora из интернета пропадут вертикальные ИИ-видео. Скорее всего, нишу Sora займет другое подобное приложение. И не было бы в этом ничего страшного, если бы такие ролики использовались исключительно в развлекательных целях. Но при помощи подобных программ создатели фейков массово создают очень правдоподобный контент, который используют в целях мошенничества или дезинформации. Так что нам, как потребителям, остается только вырабатывать насмотренность и учиться отличать реальные видео от сгенерированных. Особенно важно учить этому детей и людей пожилого возраста. Ведь они первыми становятся жертвами преступников.

ИИ-шлак уничтожает интернет. Не знаю, с каких таких доводов создатели контента решили, что нейросети помогают им улучшить производимый ими продукт, но я ИИ-слоп чую сразу.

Унылые ИИ-тексты видны опытному человеку. В них всегда много воды, повторяющиеся типовые для нейросетей речевые обороты и полное отсутствие чего-то нового. Этого дерьма становится всё больше, а некоторые люди, потребляющие такой контент, даже не видят работу генеративного производителя мусора. Да зайди ты на ChatGPT, попроси что-нибудь написать, он тебе этих статей нальёт несколько вёдер, обчитаешься по самые уши. Зачем для этого контент-площадки?

Где-то пытаются с этим чуть-чуть бороться (Хабр), где-то люди в комментах по полной матюкают ИИ-слоп (VC), где-то его засилье просто огромное (даже названия площадок не буду писать). На Фамабаре ИИ полностью запрещен в любом виде (кроме примеров, как в этой статье) - это очень правильно.

Мелкий ИП-шный бизнес взял генеративные нейросети на вооружение. И теперь нам показывают такую отталкивающую рекламу:

Унылые ИИ-тексты видны опытному человеку. В них всегда много воды, повторяющиеся типовые для нейросетей речевые обороты и полное отсутствие чего-то нового. Этого дерьма становится всё больше, а некоторые люди, потребляющие такой контент, даже не видят работу генеративного производителя мусора. Да зайди ты на ChatGPT, попроси что-нибудь написать, он тебе этих статей нальёт несколько вёдер, обчитаешься по самые уши. Зачем для этого контент-площадки?

Где-то пытаются с этим чуть-чуть бороться (Хабр), где-то люди в комментах по полной матюкают ИИ-слоп (VC), где-то его засилье просто огромное (даже названия площадок не буду писать). На Фамабаре ИИ полностью запрещен в любом виде (кроме примеров, как в этой статье) - это очень правильно.

Мелкий ИП-шный бизнес взял генеративные нейросети на вооружение. И теперь нам показывают такую отталкивающую рекламу:

Недавно мы обсуждали выступления недобросовестных артистов, которые только открывают рты под песни, полностью сгенерированные искусственным интеллектом. При этом некоторые из них даже продают билеты на такие концерты. Если будет интересно, можете почитать эти посты на моей странице на Famabara. Так вот, теперь ИИ стали использовать недобросовестные продавцы на Wildberries. И снова большая часть жертв находятся в возрастной категории 50+.

Волшебные саженцы

Весной многие владельцы дач и огородов закупают семена и саженцы. Сейчас для этого совсем необязательно ехать на специальный рынок или в магазин. Например, если вы хотите посадить на своем участке малину или клубнику, саженцы можно легко заказать, сидя на диване. На популярных маркетплейсах можно найти множество сортов этих растений. Но в этом сезоне там появились какие-то невероятные гибриды. Например, малина, растущая на двухметровом дереве вперемешку с клубникой.

Волшебные саженцы

Весной многие владельцы дач и огородов закупают семена и саженцы. Сейчас для этого совсем необязательно ехать на специальный рынок или в магазин. Например, если вы хотите посадить на своем участке малину или клубнику, саженцы можно легко заказать, сидя на диване. На популярных маркетплейсах можно найти множество сортов этих растений. Но в этом сезоне там появились какие-то невероятные гибриды. Например, малина, растущая на двухметровом дереве вперемешку с клубникой.